<

1. Ketika Kepadatan Daya per Rack (Power Density) Melebihi 20–35 kW

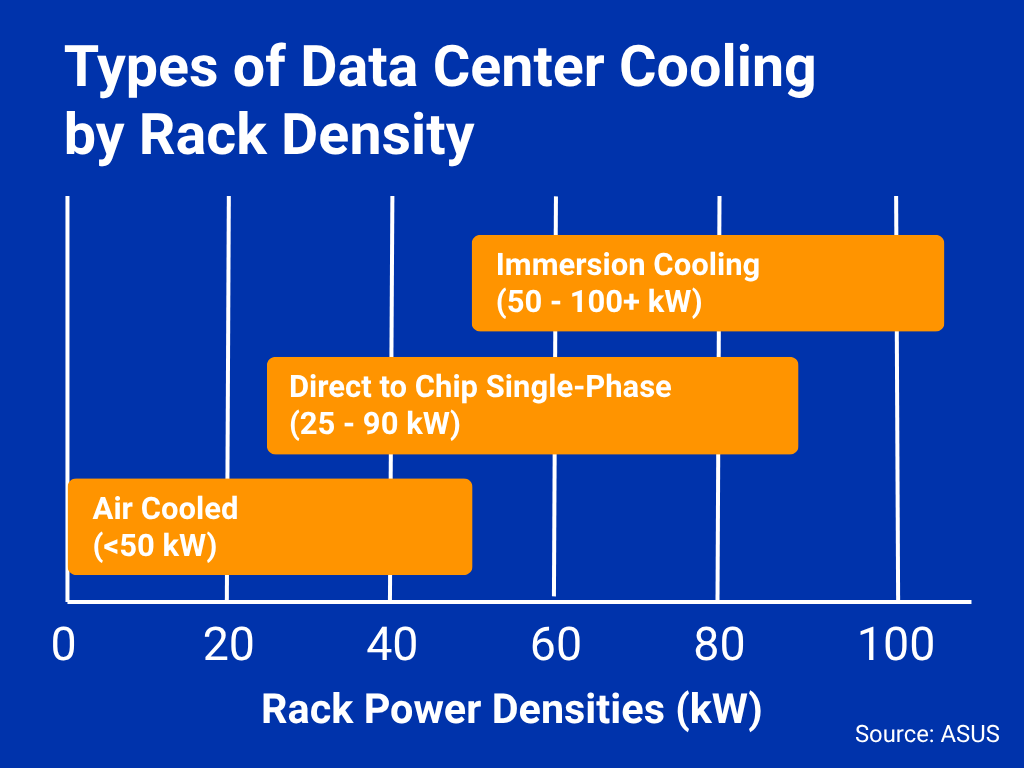

Ini adalah trigger paling umum dan paling jelas. Data center konvensional biasanya beroperasi pada 5–15 kW per rack, di mana pendinginan udara dengan CRAC/CRAH units, raised floor, dan hot/cold aisle containment masih sangat efektif. Kipas server dan sistem HVAC mampu membuang panas tanpa masalah signifikan.

Namun, seiring naiknya penggunaan prosesor dan GPU generasi baru seperti NVIDIA H100/H200 atau Blackwell yang memiliki TDP hingga 700–1.000 W per GPU, sehingga satu rack penuh dapat mencapai kepadatan 70–100 kW, bahkan proyeksi 200–250 kW di masa depan dekat. Pada level ini, air cooling memerlukan volume udara yang sangat besar, kecepatan kipas yang ekstrem (menimbulkan kebisingan tinggi), serta ruang plenum yang luas, yang sering tidak tersedia di fasilitas existing. Hasilnya: konsumsi energi pendinginan melonjak hingga 40% dari total daya data center, PUE (Power Usage Effectiveness) memburuk, dan risiko hotspot yang menyebabkan throttling performa atau downtime.

GPU generasi baru seperti NVIDIA H100/H200 atau Blackwell yang memiliki TDP hingga 700–1.000 W per GPU, sehingga satu rack penuh dapat mencapai kepadatan 30–100 kW

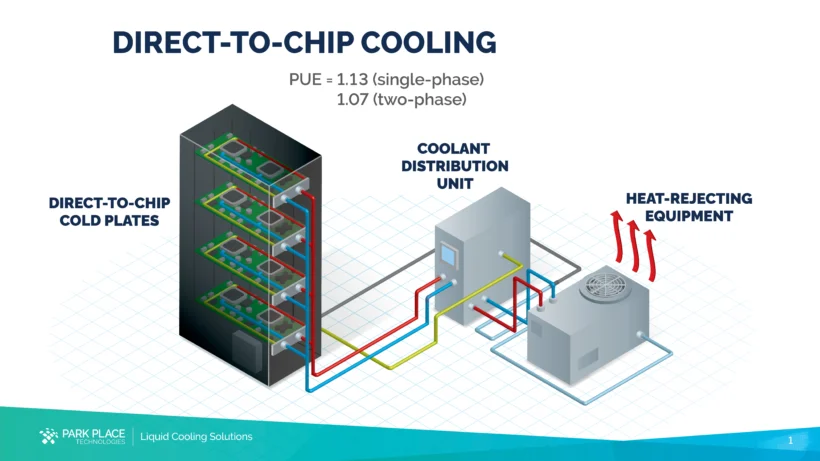

Liquid cooling (terutama direct-to-chip) langsung menempelkan cold plate ke CPU/GPU, sehingga panas diserap oleh cairan pendingin sebelum menyebar ke udara ruangan. Ini memungkinkan rack yang jauh lebih padat tanpa mengorbankan keandalan. Menurut penelitian, air cooling masih viable hingga sekitar 35 kW per rack, tetapi di atas 20–25 kW sudah sangat disarankan beralih ke liquid untuk efisiensi jangka panjang.

5 Tips for Cooling High Density Racks and Hot Spots in Your Data Center or Server Room - Cool Shield - Aisle Containment Systems

Contoh rack server high-density yang memerlukan pendinginan canggih (sumber: Cool Shield).

2. Untuk Workload AI, Machine Learning, dan HPC yang GPU-Intensif

AI training cluster dan supercomputer modern adalah “pembunuh” utama sistem pendinginan udara. Satu rack AI biasanya berisi 8–64 GPU, menghasilkan panas setara ratusan kW. Pendinginan udara sulit menangani “hotspot” lokal di chip yang bisa mencapai suhu ekstrem, sehingga performa GPU harus diturunkan (thermal throttling) untuk menghindari kerusakan.

Liquid cooling memungkinkan GPU berjalan pada clock speed maksimal 24/7, meningkatkan throughput hingga 20–30% sekaligus mengurangi konsumsi daya keseluruhan. Di data center hyperscale global, hampir semua fasilitas AI baru yang dibangun pada 2025–2026 sudah dirancang liquid-cooled dari awal. Di Indonesia, dengan iklim tropis yang memiliki suhu ambient lebih tinggi, keuntungan ini semakin terasa karena sistem air cooling harus bekerja lebih keras.

Immersion cooling to offset data centers' massive power demands gains a big booster in Microsoft | TechCrunch

Contoh immersion cooling di mana seluruh server direndam dalam cairan dielectric (sumber: TechCrunch).

3. Ketika Efisiensi Energi dan Keberlanjutan Menjadi Prioritas Utama

Pendinginan menyumbang 25–40% dari total konsumsi listrik data center. Dengan liquid cooling, panas dapat dibuang lebih efisien ke chilled water loop atau dry cooler, sehingga PUE bisa turun dari 1.5–2.0 menjadi 1.1–1.3. Ini berarti penghematan listrik jutaan kWh per tahun, pengurangan emisi karbon, dan kemudahan memenuhi regulasi ESG (Environmental, Social, Governance) yang semakin ketat di Indonesia dan Asia Tenggara.

Selain itu, liquid cooling memungkinkan heat reuse — panas yang dibuang bisa dimanfaatkan untuk pemanasan gedung atau proses industri lain, meningkatkan Energy Reuse Effectiveness (ERE).

4. Saat Melakukan Retrofit pada Data Center Existing atau Kapasitas Chilled Water Terbatas

Banyak data center di Jakarta dan sekitarnya dibangun 10–15 tahun lalu dengan desain air cooling. Saat operator ingin menambah rack AI atau HPC, fasilitas existing sering tidak mampu menambah kapasitas AC atau airflow tanpa renovasi besar. Liquid cooling bisa diimplementasikan secara hybrid (hanya pada rack high-density saja) tanpa mengubah seluruh infrastruktur, memanfaatkan existing chilled water plant.

Jenis Liquid Cooling yang Paling Umum Digunakan

Direct-to-Chip (Cold Plate): Paling populer untuk 25–90 kW/rack. Cairan mengalir melalui plate yang menempel langsung ke chip.

Immersion Cooling: Server seluruhnya direndam dalam cairan dielectric. Cocok untuk >50–100+ kW, sangat efisien tapi memerlukan hardware khusus.

Hybrid: Kombinasi air + liquid untuk transisi bertahap.

Direct-to-Chip Cooling - How it Works and its Effectiveness | Park Place Technologies

Diagram sistem direct-to-chip liquid cooling lengkap dengan cold plate, CDU, dan heat rejection (sumber: Park Place Technologies).

Keuntungan dan Tantangan

Keuntungan utama:

Pendinginan Liquid Cooling jauh lebih baik daripada Aircooling.

Densitas rack lebih tinggi → kapasitas komputasi lebih besar dalam footprint sama.

Kebisingan lebih rendah (bisa menghilangkan sebagian besar server fan).

Penghematan energi jangka panjang yang signifikan.

Tantangan:

Biaya awal lebih tinggi (cold plate, manifold, CDU).

Risiko kebocoran (meski sangat rendah pada sistem modern).

Kompleksitas maintenance dan kompatibilitas hardware.

Namun, dengan vendor seperti Vertiv, CoolIT, atau Boyd yang sudah matang, risiko ini dapat diminimalkan.

Kesimpulan

Liquid cooling bukan lagi teknologi “masa depan”, melainkan kebutuhan saat ini bagi data center yang ingin mendukung AI, menjaga efisiensi, dan tetap kompetitif. Jika rack Anda sudah mendekati atau melebihi 20–25 kW, atau Anda merencanakan deployment GPU-heavy, saatnya mempertimbangkan liquid cooling sekarang juga. Di Indonesia, dengan pertumbuhan data center yang pesat di Jakarta, Batam, dan sekitarnya, adopsi teknologi ini akan menjadi pembeda utama antara fasilitas biasa dan kelas dunia.

Referensi Artikel yang Direkomendasikan (semua diakses Februari 2026):

- “Why Liquid Cooling Is the New Standard for Data Centers in 2025” – DataCenters.com"

- “Liquid Cooling Options for Data Centers” – Vertiv"

- “The Basics of Liquid Cooling in AI Data Centers” – Flex Power Modules"

- “When Liquid Cooling Makes Sense for Data Centers” – Stack Infrastructure"

- “Data Center Liquid Cooling vs. Air Cooling” – Enconnex"

- “The Future is Liquid: How In-Rack an - CyrusOne"

Chat with us

Chat with us